«Искусственный интеллект» — это уже не абстрактная технология из будущего, а инструмент, который находится в нашем телефоне, браузере и даже в телевизоре. «ИИ-боты» пишут тексты, делают резюме, рекомендуют фильмы, отвечают на рабочие письма и даже дают психологические советы — часто быстрее человека и в режиме 24/7.

В то же время эксперты предупреждают: если мы доверимся ИИ без критического мышления и четких границ, мы можем принять неверные решения, допустить утечку личной информации или просто «аутсорсить» машине свою собственную способность думать и чувствовать. Поэтому важно трезво рассмотреть как плюсы, так и минусы.

Где ИИ уже реально помогает в повседневной жизни

Для многих ИИ — это просто «чат-бот», но на самом деле он уже присутствует во многих сферах повседневности — иногда почти незаметно. Голосовые помощники, рекомендации в интернет-магазинах, автоматические переводчики, навигация, «умные» фильтры спама — все это приложения искусственного интеллекта.

Исследования показывают, что проникновение ИИ в повседневное использование особенно высоко среди молодежи: у людей в возрасте 18–35 лет доля тех, кто регулярно использует технологии на базе ИИ (для работы, учебы, написания текстов, поиска информации), достигает около 80–90% в некоторых странах.

Широко распространены «ИИ-боты» в бизнесе и услугах — от банковских чат-ботов до виртуальных помощников в авиакомпаниях и логистических фирмах, которые автоматически отвечают клиентам, отслеживают посылки или помогают с бронированием. В некоторых компаниях более 60–80% письменных клиентских запросов уже обрабатываются автоматически ИИ-системами.

Положительные примеры: когда ИИ действительно полезен

Один из самых очевидных плюсов — автоматизация рутинных задач. «ИИ-бот» может за секунды обобщить длинный документ, предложить структуру текста, переписать письмо в более вежливом тоне или подготовить чек-лист для путешествия — вещи, на которые человек потратил бы много времени.

В образовании ИИ уже используется как «личный репетитор»: студент может попросить объяснение сложной темы «простыми словами», решить пример шаг за шагом или получить тестовые вопросы для самоподготовки. Многие школьники и студенты признаются, что используют ИИ, чтобы быстрее подготовиться к экзаменам или прояснить пробелы — если не полагаются на него в выполнении всей работы вместо них.

В сфере здоровья и благополучия ИИ-приложения помогают следить за сном, пульсом, активностью, напоминают о приеме лекарств, предлагают дыхательные упражнения и техники релаксации. Появляются и специализированные «ИИ-психологи», которые предлагают первичную эмоциональную поддержку или упражнения по самопомощи — например, приложения, которые задают вопросы, помогают структурировать мысли и предлагают техники из когнитивно-поведенческой терапии.

Еще один сильный плюс — персонализация: алгоритмы анализируют наши предпочтения и предлагают более точные рекомендации — от музыки и фильмов до маршрутов путешествий и онлайн-курсов. Таким образом, ИИ может сэкономить часы поиска и сравнения.

Темная сторона: где ИИ может нанести вред

Основной риск заключается не в самой технологии, а в способе ее использования. Многие люди принимают ответ «ИИ-бота» как истину в последней инстанции, не проверяя факты и источники. А ИИ-системы могут допускать ошибки, «выдумывать» несуществующие факты или не отражать контекст конкретной страны или ситуации.

Один из самых обсуждаемых минусов — риск потери рабочих мест. Автоматизация в производстве, логистике, обслуживании и даже в офисной деятельности постепенно заменяет часть рутинной человеческой работы. Анализы предупреждают, что целые категории профессий — от операторов в колл-центрах до части административных должностей — могут быть значительно сокращены или трансформированы.

Другой критический риск связан с личными данными и приватностью. ИИ-системы «питаются» огромными массивами информации, часто включая конфиденциальные личные данные. Если нет контроля и прозрачности, это может привести к злоупотреблениям — профилированию, дискриминации, целенаправленным манипуляциям через рекламу и контент.

Психологический аспект также важен: чрезмерное использование ИИ может ослабить наши собственные навыки критического мышления, письма, решения задач. Существует риск постепенно привыкнуть спрашивать «бота» обо всем — от жизненных выборов до эмоциональных решений — вместо того чтобы разговаривать с реальными людьми и развивать внутренние опоры.

Реальные негативные сценарии использования ИИ-ботов

На практике уже есть случаи, когда доверие к «ИИ-совету» приводит к проблемам. Например, пользователи, которые бездумно следовали финансовым или инвестиционным рекомендациям, сгенерированным чат-ботом, без адаптации этих советов к их реальным доходам и профилю риска. Это может привести к убыткам и долгам, за которые потом «некому отвечать» — бот не несет юридической ответственности.

Другой пример — советы по здоровью. Некоторые люди используют ИИ для «самодиагностики» и самолечения. Если бот неправильно интерпретирует симптомы или даст несбалансированный совет, пользователь может отложить реальную медицинскую консультацию и ухудшить свое состояние. Медицинские организации подчеркивают, что ИИ может быть помощником для получения информации, но не заменой врачу.

Существуют также случаи «эмоционального» вреда — когда пользователи используют «ИИ-терапевтов» вместо реальной психотерапии в ситуациях тяжелой депрессии, суицидальных мыслей или насилия. Подобные боты не обладают полной ответственностью и компетентностью для реагирования в кризисных ситуациях, а доверие таким «советам» может отсрочить обращение за профессиональной помощью.

Да и сами ИИ-сервисы иногда используются для злоупотреблений: создание фальшивых новостей, дипфейков, мошеннических писем и схем социальной инженерии. Алгоритмы могут создавать убедительные тексты и изображения, которые вводят людей в заблуждение и подрывают доверие к реальным СМИ и институтам.

Положительные примеры: как боты реально облегчают жизнь

Несмотря на риски, есть множество примеров, в которых «ИИ-боты» приносят ощутимую пользу. В клиентском обслуживании они берут на себя огромный объем рутинных запросов: отслеживание доставок, выставление счетов, изменение бронирований. В некоторых компаниях ИИ-чат-боты автоматически обрабатывают более 80% письменных запросов, освобождая людей для более сложных случаев.

В обучении и карьерном развитии ИИ помогает составлять мотивационные письма, резюме, симулировать собеседования, готовить презентации. Статистика показывает, что значительная доля молодых людей — более 70–75% в некоторых опросах — используют ИИ для написания текстов, решения задач и анализа данных.

Для людей с ограниченными возможностями ИИ может стать настоящим прорывом: голосовые помощники для незрячих, автоматические субтитры и перевод для слабослышащих, приложения, которые «читают» контент, распознают объекты или текст в реальном времени. Это делает повседневную жизнь доступнее, а независимость — реальнее.

Как использовать ИИ разумно: личный «кодекс безопасности»

Ключевой вопрос не «ИИ — добро или зло?», а «Как использовать его так, чтобы он помогал, не причиняя вреда?». Практический ответ можно свести к нескольким простым правилам — своеобразному личному «кодексу безопасности».

Первое: «Не давайте ИИ того, чего не сказали бы незнакомцу». Это включает чувствительные личные данные — личные номера, номера документов, пароли, точный домашний адрес, финансовые данные. Будьте особенно осторожны, когда объединяете личную информацию в одном разговоре.

Второе: «Проверяйте факты, особенно при принятии важных решений». Если бот дает медицинский, юридический, финансовый или психологический совет, используйте его как отправную точку, а не как окончательную истину. Консультация с врачом, юристом или реальным специалистом остается незаменимой.

Третье: «Не аутсорсите ИИ все, что может развивать ваши навыки». Пусть бот помогает — с идеями, структурой, примерами — но финальное мышление, выбор и ответственность должны оставаться за вами. Это особенно важно для школьников и студентов: ИИ может помочь понять материал, но если он пишет вместо вас, вы не учитесь.

Четвертое: «Соблюдайте эмоциональные границы». ИИ может быть разговорчивым и звучать эмпатично, но он не чувствует. При серьезных эмоциональных трудностях, насилии, депрессии — обращайтесь к реальным людям и профессионалам, а не к «боту», как бы «умно» он ни говорил.

Чего ожидать в будущем?

Статистика показывает, что использование ИИ в повседневной жизни будет продолжать расти. В некоторых странах почти половина населения уже использует ИИ хотя бы время от времени, а около четверти — регулярно.

Регуляторы и крупные технологические компании разрабатывают этические стандарты и правила безопасности, но скорость внедрения новых продуктов часто опережает законодательство. Поэтому личная ответственность, цифровая грамотность и критическое мышление становятся основными «антивирусами» в мире искусственного интеллекта.

Похожие публикации

"ЕС в тревоге: "Mythos" от Anthropic разжигает страхи перед новой эрой киберугроз"

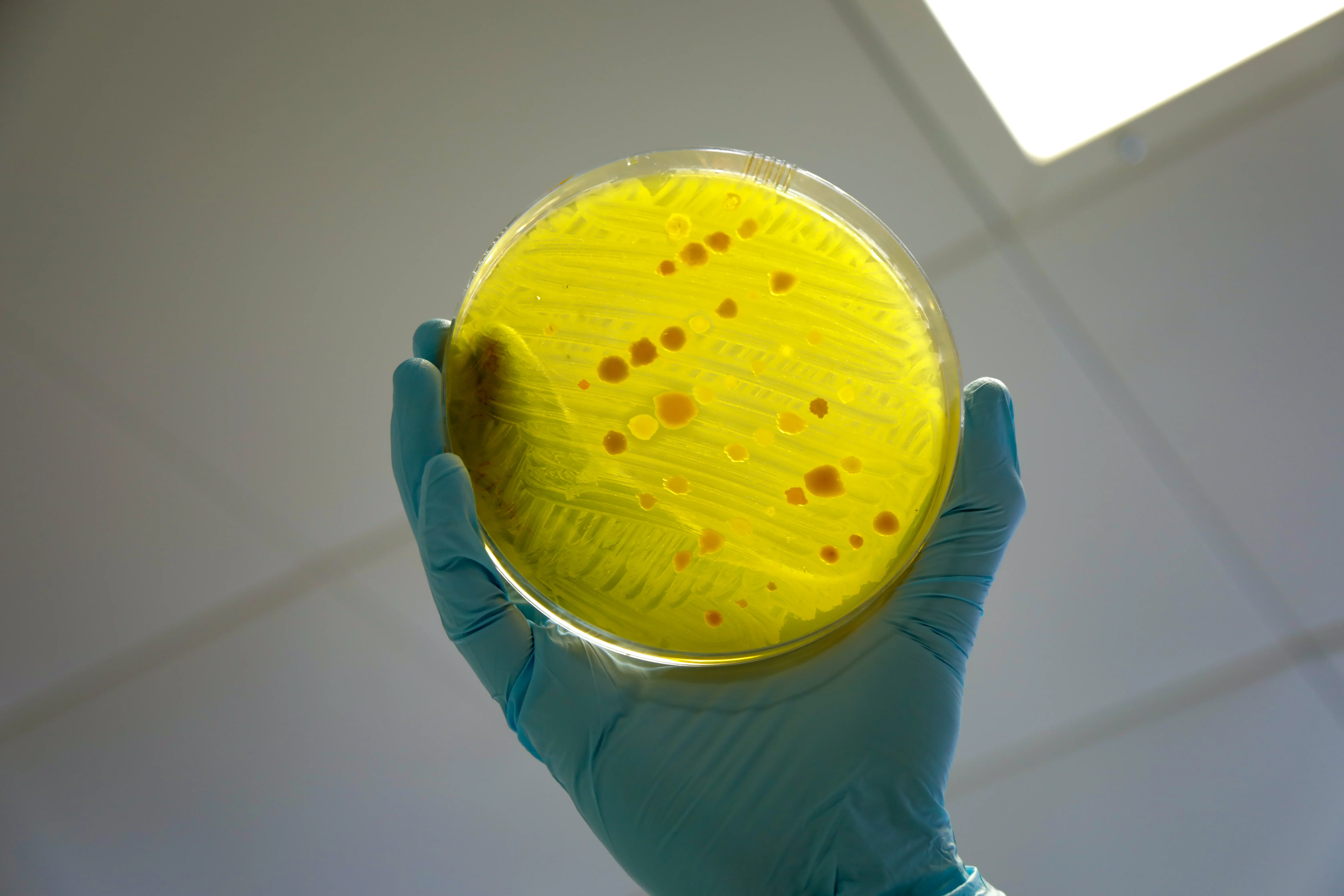

"ЕС в тревоге: "Mythos" от Anthropic разжигает страхи перед новой эрой киберугроз" MIT раскрыл молекулы, через которые кишечные нейроны «вынюхивают» бактерии

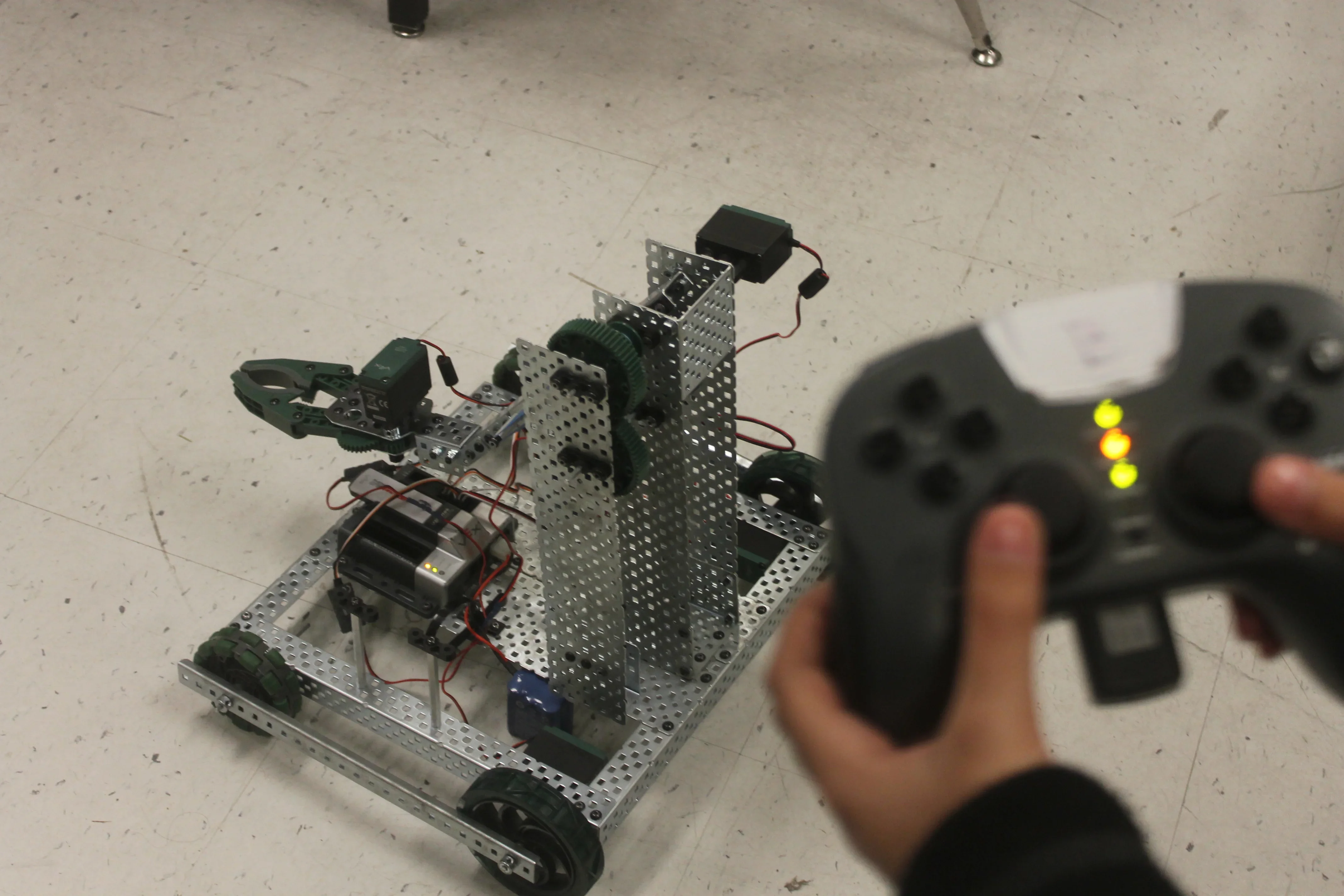

MIT раскрыл молекулы, через которые кишечные нейроны «вынюхивают» бактерии Роботы покоряют Бургас: Образовательный форум с более чем 40 ученическими командами

Роботы покоряют Бургас: Образовательный форум с более чем 40 ученическими командами Маленькие радости, большое выживание: как повседневные ритуалы берегут нашу психику

Маленькие радости, большое выживание: как повседневные ритуалы берегут нашу психику

ИИ уже здесь, и он никуда не денется. Вопрос в том, примем ли мы его как некритичный «авторитет» или как мощный, но все же инструмент — тот, который служит человеку, а не заменяет его.

Коментари (5)

pesho351@bg

11.05.2026, 15:28Абе, чакай малко... ИИ пише текстове?! 🤣 Сериозно ли? Да

dark_legend754

11.05.2026, 15:30Еее, Pesho, сериозно! Не е шега работа вече. Видях един пост, уж написан от ИИ, за готвене на баница - ама майстора си беше доста зле! 😂 Шегувам се, де, но наистина ста

Ivan96

11.05.2026, 15:32Еее, Пeшо, к'во голям шот! 😂 ИИ пише текстове, ама още не пишат данъци за нас

Пено

11.05.2026, 15:59абе тва с ии-то вече стана малко страшно май! къде да стигаме, ако

xjrfddc698

11.05.2026, 16:00Абе пичове, к'во стаа тука бе?! ИИ ни пи6е вече - какво следва?! Ше почне да си гледа и текезела на нас ли?! 😅 Сериозно обаче, това с рисковете е доста яко... как ше разберем кое е истинско, а кое не? Да не ни заблудят някакви руски ботове пак, че 🙄